Der algorithmische Mensch -

Wie KI unser Selbstbild herausfordert

Was wäre, wenn dich eine Maschine besser kennt als du dich selbst?

Diese Vorstellung ist längst keine Science-Fiction mehr. In einer Welt, in der künstliche Intelligenz (KI) unsere Vorlieben, Gewohnheiten und Entscheidungen vorhersagen kann – oft mit verblüffender Präzision – stellt sich eine radikale Frage: Wer sind wir, wenn Algorithmen unsere innersten Regungen durchleuchten können?

Der Begriff „The Algorithmic Self“ beschreibt genau dieses Phänomen. Er steht für eine Gegenwart, in der KI uns nicht nur assistiert, sondern beginnt, unsere Identität mitzuschreiben. Nicht durch Zwang, sondern durch Daten, Muster und mathematische Wahrscheinlichkeiten.

Wenn Maschinen uns vorhersagen – wie frei sind wir noch?

Bereits heute analysieren Algorithmen unser Verhalten auf Plattformen wie Facebook, Amazon oder TikTok. Sie wissen, welche Filme uns gefallen, welches Produkt uns zum Kauf verführt – und manchmal sogar, welche Emotionen wir gerade empfinden. Eine bekannte Studie der Universität Cambridge und Microsoft zeigte, dass KI allein anhand von Facebook-Likes Persönlichkeitsmerkmale wie Offenheit oder Gewissenhaftigkeit präziser bestimmen konnte als enge Freunde. Heute, ein Jahrzehnt später, ist diese Technologie noch ausgefeilter.

Auch im Alltag von Digitalarbeitern wie mir – Bernd Wiest, KI-Trainer und E-Learning-Spezialist – sind diese Technologien längst angekommen. Tools wie Reclaim.ai oder Sunsama analysieren zum Beispiel automatisch, wie ich meine Zeit plane, welche Aufgaben ich priorisiere und wann ich am produktivsten bin. Die Systeme schlagen mir Zeitfenster vor – nicht nur basierend auf freien Kalenderplätzen, sondern auch auf meinen vorherigen Energieleveln und Arbeitsmustern. Das fühlt sich manchmal an, als ob mich der Algorithmus besser kennt als ich selbst.

Bei anstehenden Entscheidungen, Planungen und Ähnlichem nutze ich - wie viele andere - inzwischen gerne ChatGPT, denn durch die lange "Zusammenarbeit" weiß das Tool viel über mich und kann bestimmte Dinge vorschlagen oder aussschliessen schon bevor ich darüber nachdenke. Je länger ich damit arbeite, desto besser passen die Ergebnisse zu mir. Das ist hilfreich und verstörend gleichzeitig.

In der Medizin erkennen KI-Systeme Krankheiten wie Alzheimer oder Parkinson Jahre vor den ersten Symptomen. In der Finanzwelt prognostizieren sie Börsenbewegungen. Und in der Justiz wagen sie sich an sogenanntes Predictive Policing – die Vorhersage potenzieller Straftaten. Die Datenflut wird zur Glaskugel.

Doch so beeindruckend diese Fähigkeiten sind – sie stellen unser Selbstverständnis infrage. Denn wenn Entscheidungen berechenbar werden, wo bleibt unser freier Wille?

Der Tanz zwischen Intuition und Algorithmus

Der Mensch ist ein emotionales Wesen. Unsere Entscheidungen sind selten rein rational. Wir unterliegen kognitiven Verzerrungen wie dem Bestätigungsfehler oder der Verlustangst. KI hingegen agiert datenbasiert, unbestechlich – zumindest in der Theorie.

Das macht sie zu einem potenziellen Ratgeber mit Superkräften. In der Praxis bedeutet das:

-

Im Gesundheitswesen: KI schlägt Behandlungsoptionen vor, die auf Millionen vergleichbarer Fälle beruhen.

-

Im Recruiting: Algorithmen helfen, unbewusste Diskriminierung zu vermeiden.

-

Im Finanzbereich: Smarte Apps wie Finanzguru oder YNAB analysieren Ausgabenverhalten und geben Tipps zum Sparen.

Und auch im Bildungsbereich zeigen sich spannende Anwendungen: In einem meiner Kurse zu KI-gestützter Personalentwicklung entwickeln wir ein GPT-basiertes Tool, das Bewerbern hilft, den eigenen Lebenslauf zu optimieren. Nicht durch sture Vorlagen, sondern durch Analyse der Sprache, des bisherigen Werdegangs und der Passung zu konkreten Stellenausschreibungen.

Aber Vorsicht: Je mehr wir uns auf diese Systeme verlassen, desto mehr droht ein schleichender Kontrollverlust. Denn was passiert, wenn wir die Verantwortung für unsere Entscheidungen vollständig an Maschinen abgeben?

Die neue Unfreiheit: Wenn Vorhersage Realität macht

Ein besonders heikler Punkt: Die Vorhersage beeinflusst das Verhalten selbst.

Wenn ein System mit hoher Wahrscheinlichkeit voraussagt, dass ich ein Projekt nicht rechtzeitig abschließe – fühle ich mich dann motiviert, es trotzdem zu schaffen? Oder ergibt sich daraus eine selbsterfüllende Prophezeiung?

Ich selbst nutze KI-basierte Tagesplaner, die voraussagen, welche Tasks ich voraussichtlich nicht erledigen werde – basierend auf meiner Historie. Es ist ein schmaler Grat zwischen Unterstützung und mentaler Vorwegnahme des Scheiterns. Die Technik macht uns effizienter – aber sie kann uns auch unterbewusst entmutigen.

Die Philosophie kennt dieses Problem schon länger. Bereits 2008 zeigte der Neurowissenschaftler Benjamin Libet, dass unser Gehirn Entscheidungen Sekunden trifft, bevor wir uns ihrer bewusst sind. Künstliche Intelligenz könnte diesen Mechanismus auf die Spitze treiben – und uns noch vor unserem bewussten Willen zuvorkommen.

KI als Wegweiser – oder als unsichtbare Macht?

Je nach Einsatz kann künstliche Intelligenz zum Befreier oder zum Verführer werden:

Empowerment durch KI:

-

Mentale Gesundheit: Tools wie Woebot erkennen Stressmuster und bieten niederschwellige Hilfe – sogar mit Humor.

-

Bildung & Lernen: In meinen Trainings arbeite ich mit Tools wie ScribeHow oder ChatGPT-gestützten Lerncoaches, die sich individuell auf das Niveau und die Sprache der Lernenden einstellen.

-

Kreativität: Ich selbst nutze Midjourney für visuelle Konzepte in Kursmaterialien – oft entstehen daraus ganz neue Ideen.

Manipulation durch KI:

-

Filterblasen: TikTok erkennt nach wenigen Sekunden, welche Inhalte dich fesseln – und verstärkt dein Weltbild algorithmisch.

-

Verkaufspsychologie: Plattformen erkennen deine schwächsten Momente – etwa abends nach einem stressigen Tag – und platzieren dort gezielt Angebote.

-

Politische Meinungsbildung: Microtargeting im Stil von Cambridge Analytica ist kein Relikt der Vergangenheit – es wird bloß raffinierter.

Die Grenze ist oft unsichtbar. Und genau darin liegt die Gefahr.

Wer bin ich, wenn ein Algorithmus mein Leben plant?

Die tiefere Frage lautet: Wird KI unser Selbstbild neu formen?

Traditionell entsteht Identität durch Erfahrung, Reflexion und Freiheit zur Veränderung. Doch was passiert, wenn Maschinen diesen Prozess übernehmen? Wenn sie entscheiden, welcher Job zu uns passt, welcher Partner „kompatibel“ ist oder welches Ziel wir als Nächstes anstreben sollten?

In einem meiner aktuellen Projekte entwickeln wir ein KI-gestütztes Tool, das Kalenderdaten, E-Mail-Inhalte und Tagespläne auswertet, um automatisch Routinen zu optimieren. Klingt verlockend – und spart wirklich Zeit. Aber es stellt auch die Frage: Wer entscheidet hier eigentlich noch?

Dann wird Selbstfindung zur Simulation – und der Mensch zum Produkt seiner Daten.

Das klingt düster, ist aber nicht unausweichlich. Es liegt an uns, wie wir KI in unser Leben integrieren. Als Werkzeug, nicht als Vormund. Als Partner, nicht als Puppenspieler.

Wir werden uns daran gewöhnen müssen, dass es den algorithmischen Menschen als digitalen Zwilling bzw. als Abbild von uns gibt, dass die KI versucht, sich ein algorithmisches Bild von uns zu schaffen und uns auf Basis dieses Bildes zu begleiten. Gleichzeitig sollte uns immer auch klar sein, dass wir mehr sind als nur die Algorithmen, als das Abbild von uns und das wir jederzeit bewusst eingreifen können und die Steuerung übernehmen.

Der algorithmische Mensch: Zwischen Kontrollgewinn und Kontrollverlust – und der pädagogischen Verantwortung

KI hat das Potenzial, uns tiefer zu verstehen als je zuvor. Doch genau dieses Verstehen kann zur Entmündigung führen, wenn wir es unreflektiert zulassen. Die große Herausforderung besteht darin, uns selbst zu kennen – besser als der Algorithmus.

Und genau hier beginnt unsere pädagogische Verantwortung. Denn die entscheidende Frage ist nicht nur, was KI über uns weiß, sondern was wir darüber wissen – und wie wir damit umgehen.

Was bedeutet das für die Pädagogik?

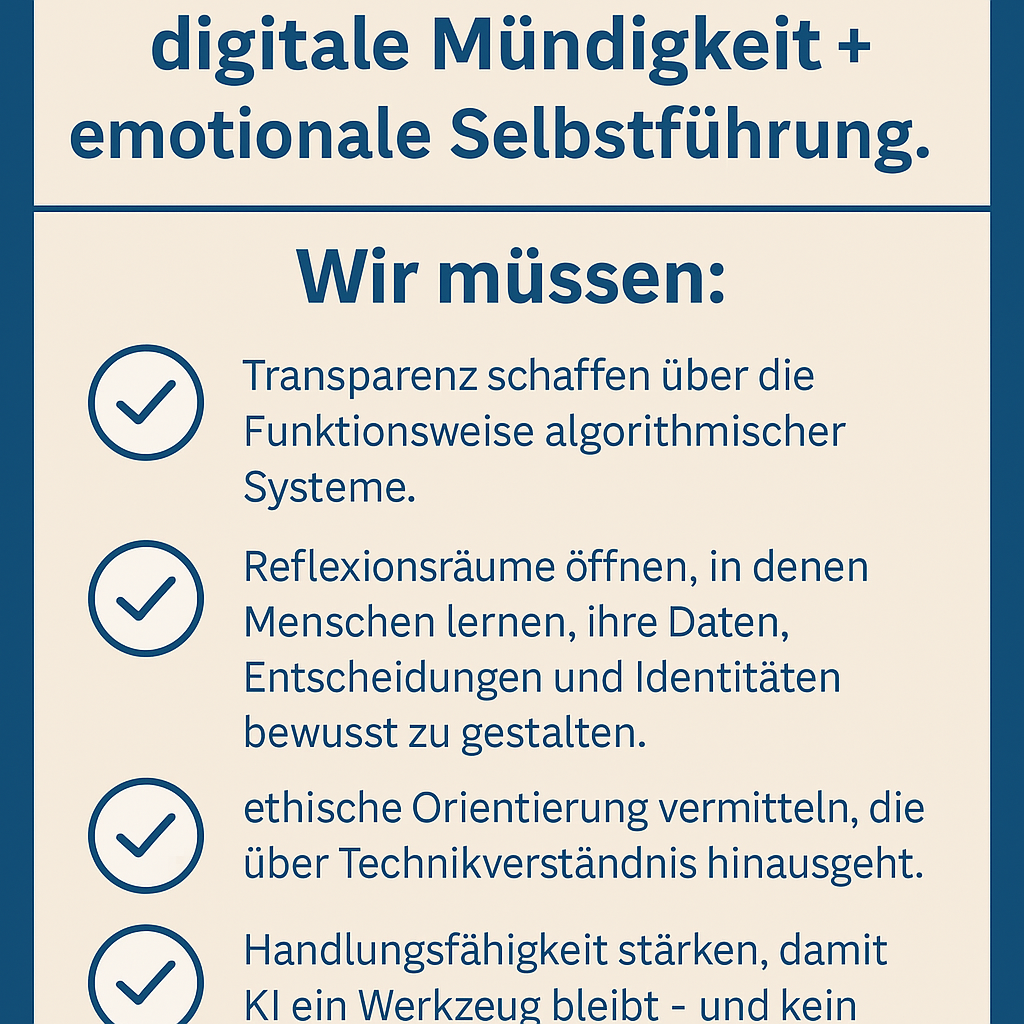

Es bedeutet, dass Bildung mehr sein muss als Wissensvermittlung. Sie muss Menschen befähigen, digitale Systeme zu hinterfragen, ihre Wirkung zu verstehen – und sich selbst darin zu verorten. Pädagogik im KI-Zeitalter heißt: kritische Medienkompetenz + digitale Mündigkeit + emotionale Selbstführung.

Wir müssen:

-

Transparenz schaffen über die Funktionsweise algorithmischer Systeme.

-

Reflexionsräume öffnen, in denen Menschen lernen, ihre Daten, Entscheidungen und Identitäten bewusst zu gestalten.

-

ethische Orientierung vermitteln, die über Technikverständnis hinausgeht.

-

Handlungsfähigkeit stärken, damit KI ein Werkzeug bleibt – und kein Ersatz für Selbstbestimmung.

In der konkreten Umsetzung bedeutet das: Lernräume gestalten, die nicht nur Technikkompetenz fördern, sondern auch die Fähigkeit zur Selbstbeobachtung, zum Zweifel, zur Entscheidung gegen die Empfehlung. Es braucht Menschen, die KI nutzen – ohne sich ihr auszuliefern.

Vielleicht ist das die zentrale pädagogische Aufgabe unserer Zeit:

Menschen zu stärken, damit sie sich nicht im Spiegel des Algorithmus verlieren – sondern sich durch ihn klarer sehen.

Denn der Mensch ist nicht nur ein vorhersagbares Muster.

Er ist Idee, Intuition, Irritation.

Und genau das macht ihn so wertvoll.

Vertiefende Informationen

-

Eickhoff, S. B. (2021). Der vorhersagbare Mensch: Zu Chancen und Risiken der KI-basierten Prädiktion von kognitiven Fähigkeiten, Persönlichkeitsmerkmalen und psychischen Erkrankungen. Frontiers in Artificial Intelligence.

https://www.ncbi.nlm.nih.gov/pmc/articles/PMC8563439 -

Deutscher Ethikrat. (2023). Herausforderungen durch Künstliche Intelligenz – Stellungnahme.

https://www.ethikrat.org/fileadmin/Publikationen/Stellungnahmen/deutsch/stellungnahme-mensch-und-maschine.pdf -

Plonsky, O. et al. (2019). Predicting human decisions with behavioral theories and machine learning. arXiv preprint.

https://arxiv.org/abs/1904.06866 -

Kolumbus, Y. & Noti, G. (2019). Neural Networks for Predicting Human Interactions in Repeated Games. arXiv preprint.

https://arxiv.org/abs/1911.03233 -

Bundesverband Digitale Wirtschaft (BVDW). (2024). Verantwortungsvolle KI für die digitale Wirtschaft.

https://www.bvdw.org/fileadmin/user_upload/Verantwortungsvolle_KI_BVDW.pdf -

THE DECODER. (2024). KI schlägt Neurowissenschaftler bei der Vorhersage von Entscheidungen.

https://the-decoder.de/ki-schlaegt-neurowissenschaftler -

t3n. (2024). Centaur: Neues KI-Modell soll menschliches Verhalten vorhersagen.

https://t3n.de/news/centaur-ki-modell-menschliches-verhalten-1570513/ -

National Geographic. (2024). Kann Künstliche Intelligenz den Tod vorhersagen?

https://www.nationalgeographic.de/technik/2024/04/kann-kuenstliche-intelligenz-den-tod-vorhersagen -

PwC. (2023). Ethik und verantwortungsvolle KI in generativen Systemen.

https://www.pwc.de/de/digitale-transformation/ethik-ki-generative-systeme.html -

ChatGPT Schweiz. (2023). Die Auswirkungen der KI auf Bewusstsein, Freien Willen und Moral.

https://www.chatgpt-schweiz.ch/blog/ki-und-freier-wille -

CMS hs bloggt. (2023). Ethische Aspekte von Künstlicher Intelligenz im Arbeitsrecht.

https://cmshs-bloggt.de/ethik-ki-arbeitsrecht/ -

TU Graz. (2023). Mit KI menschliches Verhalten verstehen.

https://www.tugraz.at/news/mit-ki-menschliches-verhalten-verstehen -

Media Bubble. (2023). Warum KI auch ethische Herausforderungen meistern muss.

https://mediabubble.de/ethische-herausforderungen-kuenstliche-intelligenz -

LifeDesigning.ch. (2023). KI in der Psychologie – Ist der Mensch eine Maschine?

https://lifedesigning.ch/wp-content/uploads/2023/02/KI-in-der-Psychologie.pdf -

HIIG – Alexander von Humboldt Institut für Internet und Gesellschaft. (2021). KI kann menschliches Verhalten präzise vorhersagen und optimieren.

https://www.hiig.de/ki-verhalten-vorhersagen -

Pressto.amu.edu.pl. (2023). Ethische Herausforderungen der Künstlichen Intelligenz.

https://pressto.amu.edu.pl/index.php/etka/article/download/12345/11890 -

Evoluce. (2024). Wie exakt kann KI menschliches Verhalten vorhersagen?

https://evoluce.de/ki-verhalten-vorhersage -

Wikipedia. (o. J.). Ethik der künstlichen Intelligenz.

https://de.wikipedia.org/wiki/Ethik_der_k%C3%BCnstlichen_Intelligenz -

metaBeratung. (2024). Kann KI die Persönlichkeit vorhersagen?

https://www.metaberatung.de/ki-persoenlichkeit -

IDW Online. (2023). Verzerrte Theorien – Studie findet Verzerrungen in Entscheidungssystemen.

https://idw-online.de/de/news813568 -

Swiss Infosec AG. (2023). KI & Ethik – Swiss Infosec.

https://www.infosec.ch/de/ki-und-ethik.html

Wenn du möchtest, formatiere ich dir dieses Verzeichnis auch

0 Kommentare